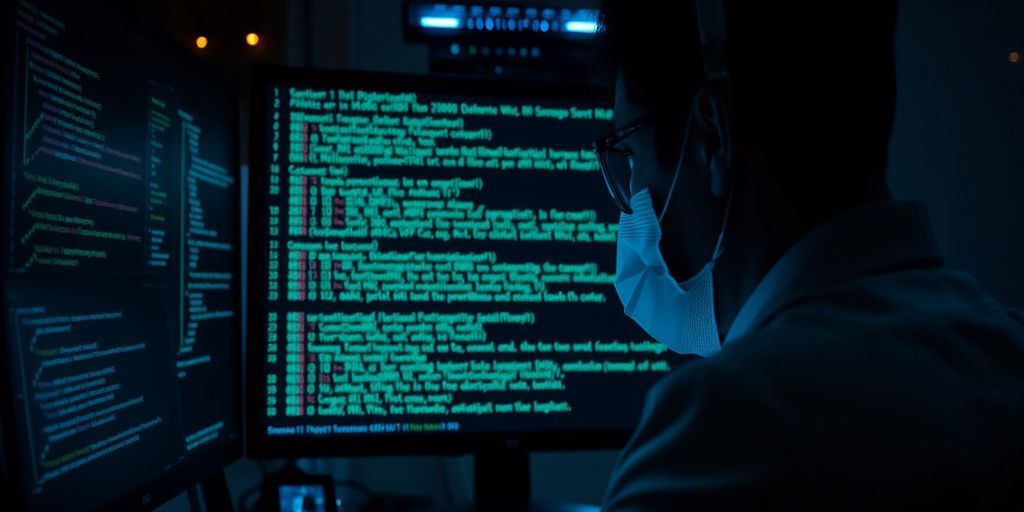

Les faux installateurs de code Claude livrent des malwares voleurs d'identifiants : Une plongée technique dans le paysage des menaces

Les faux installateurs Claude AI propagent des malwares sophistiqués dérobant clés API, identifiants développeur, portefeuilles crypto et données sensibles.